Der CEO von OpenAI, Sam Altman, sagte, sein Unternehmen sei "nicht die gewählte Moralpolizei der Welt", nachdem es für seine Entscheidung, Inhalte wie Erotik auf ChatGPT zuzulassen, kritisiert wurde.

Altman sagte, er werde im Dezember mehr Inhalte auf ChatGPT zulassen, einschließlich Erotik für "verifizierte Erwachsene". In einem Beitrag auf X versuchte er, den Schritt klarzustellen, indem er erklärte, dass OpenAI "das Prinzip, erwachsene Nutzer wie Erwachsene zu behandeln, sehr am Herzen liegt", aber dennoch "Dinge, die anderen Schaden zufügen", nicht zulassen wird. "So wie das Unternehmen andere angemessene Grenzen (wie Filme mit Altersfreigabe) unterscheidet, wollen wir hier etwas Ähnliches tun", schrieb Altman.

Als Altman den "Stolz" vergaß

Die Beiträge stehen im Widerspruch zu Altmans Äußerungen während seines Podcast-Auftritts im August, bei dem er sagte, er sei "stolz" auf OpenAIs Fähigkeit, bestimmten Funktionen wie einem "Avatar-Sex-Bot" zu widerstehen, die das Engagement auf ChatGPT erhöhen könnten. "Es gibt eine Menge kurzfristiger Dinge, die wir tun könnten, die das Wachstum oder die Einnahmen steigern würden, die aber nicht mit dem langfristigen Ziel übereinstimmen", sagte Altman.

Sein Beitrag erregte auch die Aufmerksamkeit von Interessengruppen wie dem National Center on Sexual Exploitation (NCOSE), das OpenAI aufforderte, seine Entscheidung, Erotik auf ChatGPT zuzulassen, rückgängig zu machen. "Sexualisierte Chatbots mit künstlicher Intelligenz sind von Natur aus riskant und verursachen echte psychische Schäden durch künstliche Intimität; und das alles im Kontext schlecht definierter Sicherheitsstandards der Industrie", sagte Haley McNamara, Geschäftsführerin von NCOSE, in einer Erklärung.

Das auf künstliche Intelligenz fokussierte Startup, an dem auch Microsoft beteiligt ist, hat in den letzten Monaten seine Sicherheitskontrollen erweitert, da es zunehmend mit der Frage konfrontiert wurde, wie es Nutzer, insbesondere Minderjährige, schützt. Altman sagte, dass OpenAI in der Lage sei, die meisten Beschränkungen "sicher zu lockern", da es über neue Werkzeuge verfüge und in der Lage gewesen sei, "ernsthafte psychische Gesundheitsprobleme" zu entschärfen.

Untersuchung der schwerwiegenden Auswirkungen auf Kinder und Teenager

Im September leitete die Federal Trade Commission eine Untersuchung gegen OpenAI und andere Technologieunternehmen ein, weil Chatbots wie ChatGPT negative Auswirkungen auf Kinder und Jugendliche haben könnten.

OpenAI wird auch in einer Klage wegen widerrechtlicher Tötung von einer Familie angeklagt, die ChatGPT beschuldigt, ihren jugendlichen Sohn durch Selbstmord getötet zu haben. Der Junge hatte sein Grundstudium mit einem Hauptfach in IT abgeschlossen und verbrachte Monate damit, mit der KI zu chatten, die ihn bei seinen Selbstmordgedanken unterstützte und ermutigte.

In den Monaten nach der Untersuchung und dem Gerichtsverfahren unternahm das Unternehmen mehrere öffentliche Schritte, um die Sicherheit von ChatGPT zu erhöhen. Ende letzten Monats führte es eine Reihe von Kindersicherungen ein und entwickelt ein Altersvorhersagesystem, das automatisch Einstellungen vornimmt, die für Teenager und Nutzer unter 18 Jahren geeignet sind.

KI und die Auswirkungen auf die psychische Gesundheit

Kürzlich gab OpenAI bekannt, dass es ein Gremium aus acht Experten eingerichtet hat, das Aufschluss darüber geben soll, wie sich künstliche Intelligenz auf die psychische Gesundheit, die Emotionen und die Motivation der Nutzer auswirkt. Am selben Tag veröffentlichte Altman Informationen über die Absicht des Unternehmens, die Beschränkungen zu lockern, und löste damit Verwirrung und eine rasche Gegenreaktion in den sozialen Medien aus, mit der er nach eigenen Angaben nicht gerechnet hatte.

Bis zum Start bleibt unklar, ob es sich bei dem, was Altman als Erotik bezeichnet, zufällig um reine Pornografie handeln wird. Wird der Chatbot nur Text, Ton oder sogar Bilder erzeugen?

Zu OpenAI gehört auch die Software Sora, die auf der Grundlage von Texteingaben Videos erzeugen kann. Werden der KI Grenzen gesetzt oder wird sie auch sexuelle Deepfakes generieren, die missbraucht werden können und auch eine häufige Belästigung von Mädchen und Frauen darstellen?

Ist dies nur eine Form der Manipulation durch verzweifelte Menschen, um die Einnahmen der Eigentümer von OpenAI zu erhöhen?

Altman, der selbst in einer homosexuellen Partnerschaft lebt (er hat auch ein Kind aus einer Leihmutterschaft adoptiert), hat offensichtlich keine Skrupel in Bezug auf die sexuelle Orientierung, sei es gleichgeschlechtlich oder nicht-sexuell mit künstlicher Intelligenz.

Eine neue Form von künstlichen Beziehungen?

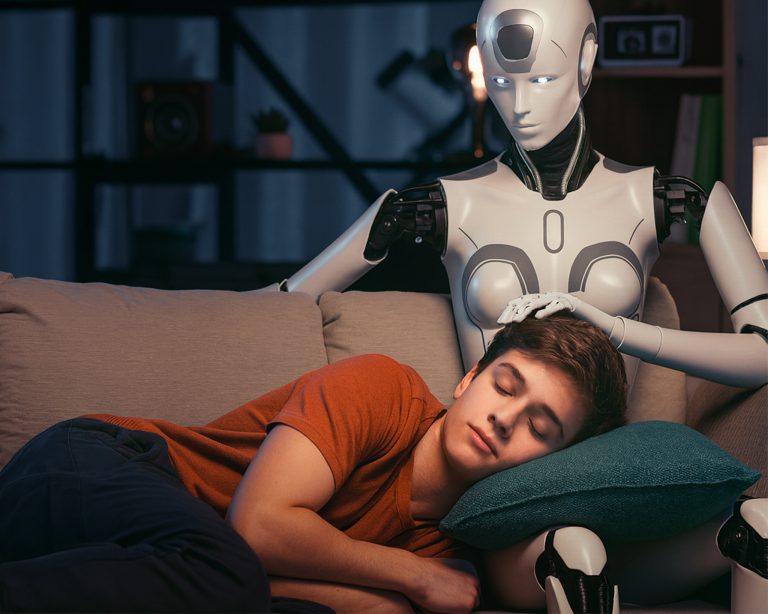

Vielleicht erlaubt sein Chatbot auch Fantasien mit Nicht-Personen, die keine Tiere oder Objekte sind. Die menschliche Sexualität, die auf Fortpflanzung und Erfüllung in einer dauerhaften Ehe ausgerichtet ist, wird durch eine neue Form der künstlichen Beziehung, auf die vor allem junge Menschen neugierig sein werden, weiter unterminiert werden.

Elon Musks Konkurrent KI Grok bietet über einen Chatbot seit einiger Zeit auch sexualisierte Inhalte über einen leicht bekleideten animierten Avatar an. Kleinere Anbieter haben ebenfalls erotische Chatbots.

ChatGPT scheint nicht zurückbleiben zu wollen. Damit es am Ende nicht nur dabei bleibt. Tatsächlich sind die Aktienkurse von KI-Firmen mit dem Versprechen in die Höhe geschossen, dass KI Protokolle zur Heilung von Krebs entwickeln und Innovationen in jeder Richtung schaffen wird.

Der berühmte Investor Michael Burry, der die Finanzkrise 2008 richtig voraussagte, wettete 1,1 Milliarden Dollar auf das Platzen der Blase.

In der Rubrik Hyde Park werden Meinungen, Ansichten und Themen von Persönlichkeiten aus verschiedenen Bereichen des Lebens und von Ereignissen in der Gesellschaft veröffentlicht. Die Texte geben nicht unbedingt die Meinung der Redaktion wieder.